Una cifra llamativa sirve para comenzar a comparar visión y captura técnica. Roger N. Clark propuso 576 megapíxeles como equivalente teórico al combinar campo visual y detalle de la fóvea.

Esta cifra no describe un sensor físico. Es una guía para entender límites entre retina, cristalino y sensores de una cámara.

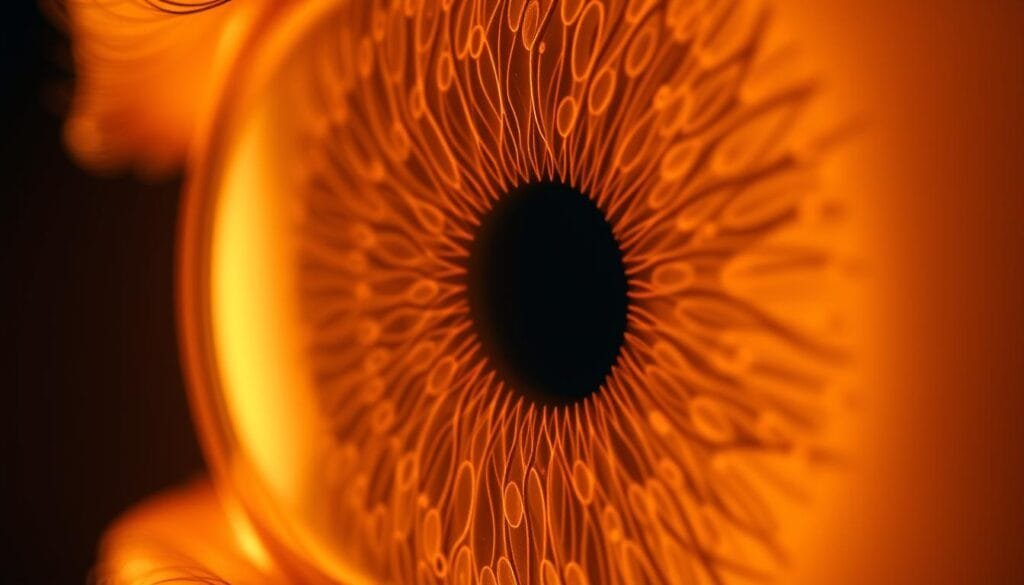

En la práctica, la percepción surge de millones de bastones y conos en cada retina. La nitidez máxima queda en una zona estrecha, mientras el cerebro reconstruye el resto mediante movimiento ocular.

En Chile esto ayuda a valorar por qué marcas buscan cifras altas, como aspiración técnica, sin replicar la interpretación que hace el cerebro de la realidad.

Puntos clave

- 576 megapíxeles es una estimación orientativa, no un sensor real.

- La nitidez máxima se concentra en pocos grados del campo visual.

- La visión funciona como video continuo, no como foto única.

- Comparar cámaras y sistema visual ayuda a entender ventajas y límites.

- Marcas persiguen mayor resolución, pero falta replicar la interpretación cerebral.

El ojo humano y los megapíxeles: qué significa realmente comparar visión y cámara hoy

Hablar de resolución entre visión y cámaras exige separar cifras de percepción. Muchas comparaciones usan 576 megapíxeles como referencia por estimaciones de Roger N. Clark. Esa cifra surge al combinar la agudeza máxima de la fóvea con el amplio campo visual para obtener un equivalente de detalle.

Importante: esa cifra funciona como atajo conceptual, no como medida directa de fotorreceptores ni del procesamiento cerebral. La visión integra micro-movimientos, variaciones de enfoque y prioridades atencionales para componer imágenes continuas.

Al comparar, conviene considerar parámetros técnicos: sensibilidad equivalente cercana a ISO 800, rango dinámico medio ~10.000:1 (≈13,5 pasos) y pico teórico hasta ~1.000.000:1 (≈20 pasos).

La nitidez máxima ocupa unos 2–3° centrales; hacia la periferia baja el color y el detalle. En baja iluminación la adaptación eleva la sensibilidad con el tiempo, sin comportarse como un ISO fijo. El tiempo de integración típico ronda 1/100 s, sin largas exposiciones naturales.

- Qué busca el lector: entender qué parámetros se traducen a especificaciones y cuáles no.

- Qué tener cuenta: «megapíxeles» comunica detalle percibido, pero omite el procesamiento del cerebro.

- Primer balance: la comparación es útil como orientación si se considera contexto y límites perceptuales.

Si el ojo fuera una cámara: especificaciones clave y cómo se miden en la práctica

Traducir la anatomía visual a cifras fotográficas ayuda a entender límites y ventajas. Aquí se explican cifras útiles y cómo se obtienen en tests prácticos.

Resolución y «576 megapíxeles»

La resolución percibida suma ~6 MP en color y ~100 MP en B/N según distribución de conos y bastones. La nitidez real queda en ~2–3° centrales, donde la fóvea concentra detalle.

Sensibilidad y exposición

La sensibilidad equivalente ronda ISO 800 en condiciones medias. La adaptación a baja luz sube la eficacia tras segundos; de noche la visión puede aumentar cientos de veces su sensibilidad.

La integración temporal típica está cerca de 1/100 s, por eso no hay largas exposiciones naturales.

Rango dinámico y células

El rango dinámico medio se estima en 10.000:1 (~13,5 pasos) y puede llegar a 1.000.000:1 (~20 pasos) en óptimas condiciones. Bastones y conos traducen fotones en señales que actúan como un sensor ccd/CMOS biológico.

| Característica | Órgano visual | Canon EOS 600D | Sensor hipotético |

|---|---|---|---|

| Resolución práctica | 6 MP color / 100 MP B/N | 18 MP | 100 MP |

| Sensibilidad | ≈ ISO 800 (adaptable) | ISO 100–6400 | ISO 100–12800 |

| Rango dinámico | 10.000:1 (13,5 pasos)–1.000.000:1 (20 pasos) | ~11,5 pasos | ~14 pasos |

| Exposición típica | ≈ 1/100 s | Variable (largo posible) | Variable |

Analogías útiles: la pupila actúa como diafragma, cristalino como sistema de enfoque y retina como sensor que procesa información antes de formar imagen.

Más allá de los números: cómo el cerebro, la anatomía y las cámaras gestionan la imagen

Ver no es guardar una foto. El cerebro integra micro‑movimientos, parpadeos y fijaciones para construir una escena estable a partir de muchas tomas breves.

Ese procesamiento rellena huecos, corrige ángulos muertos y compensa pérdida de color en periferia. Por eso la percepción resulta una interpretación, no un archivo fijo.

Procesamiento cerebral

El cerebro combina secuencias y prioriza detalles según atención. En condiciones de poca luz adapta sensibilidad y exposición sobre la marcha; esa respuesta temporal es difícil de replicar en una cámara.

Pupila, cristalino y retina vs diafragma, enfoque y sensor

La pupila actúa como diafragma; cristalino como sistema de enfoque. Pero la retina curva atenúa aberraciones que un sensor plano debe corregir con óptica o software.

Objetivos de la industria

Marcas buscan más resolución: tras la referencia de 576 megapíxeles, hay iniciativas hacia 600 MP. Aun así, una cámara perfecta nunca podrá reproducir la interpretación completa que hace el sistema visual en tiempo real.

- Tener cuenta: no reducir la comparación a resolución.

- Considerar sensor, rango dinámico, exposición y procesamiento.

- Observar escenarios donde cámaras superan al ojo, como largas exposiciones o visión fuera del espectro visible.

Conclusión

La comparación entre visión y cámara revela funciones diferentes, no equivalencias exactas. La cifra de 576 MP ayuda a visualizar detalle, pero la experiencia real depende del rango disponible y de la luz en cada escena.

La percepción usa al cerebro para completar vacíos y priorizar información. En cambio, una cámara captura imágenes discretas pensadas para editar o compartir.

Si vas a elegir equipo, mira más allá de megapíxeles. Evalúa cómo una cámara gestiona rango, exposición y ruido según la luz donde más fotografíes. Para entender mejor la resolución y límites de los ojos, consulta esta guía sobre resolución de ojos.

En suma: cada sistema resuelve problemas distintos. Tenerlo en cuenta mejora la decisión cada vez que compares imagen en vivo y captura fotográfica.